研究背景

材料科学的研究依赖于海量文献数据,但传统的人工数据提取方式效率低下且耗时。随着人工智能(AI)技术的发展,自然语言处理(NLP)和大语言模型(LLM)为材料科学带来了革命性的变革。通过自动提取和分析科学文献中的材料信息,NLP和LLM能够加速材料发现、优化合成路径,并推动自主研究。然而,材料科学的复杂性和领域特殊性对现有模型提出了挑战,需要更精准的数值理解、定量预测和科学推理能力。

前言

本文综述了NLP和LLM在材料科学中的应用,重点探讨了自动数据提取、材料发现和自主研究的进展。文章回顾了NLP技术的发展历程,从早期基于规则的方法到现代基于深度学习的LLM,并展示了其在材料信息编码、性能预测和实验设计中的潜力。尽管LLM在通用任务中表现出色,但在材料科学领域的应用仍需解决数值理解、领域知识整合和计算资源优化等问题。未来,结合检索增强生成(RAG)和强化学习(RL)等技术,LLM有望成为材料研究的强大工具。

亮点总结

1. 自动数据提取:NLP技术能够从科学文献中高效提取材料成分、合成路径和性能数据,显著提升研究效率。

2. 材料发现:通过词嵌入和语言模型,相似材料可以被快速识别,加速新材料的筛选和设计。

3. 自主研究:AI代理结合LLM和实验工具,能够自主设计、规划和执行复杂实验,推动材料科学的自动化。

4. 挑战与机遇:模型在数值理解、定量预测和领域知识整合方面仍需改进,未来可通过知识提取和强化学习优化性能。

内容介绍

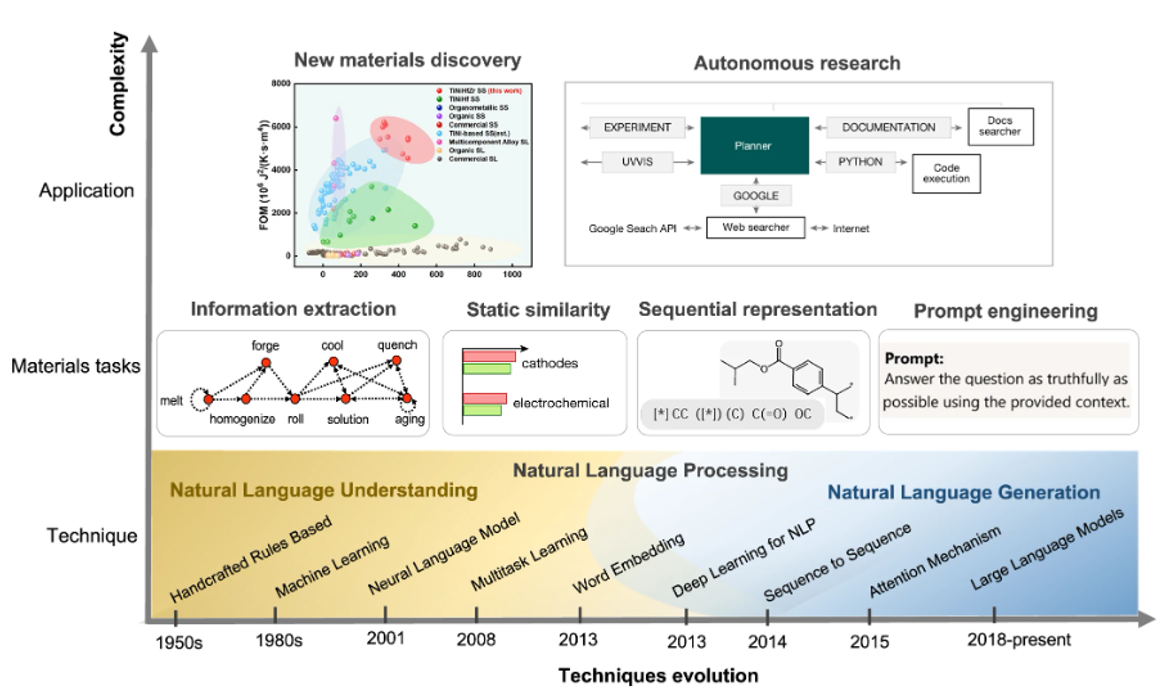

文章首先回顾了自然语言处理(NLP)技术的发展历程,从20世纪50年代基于规则的系统,到80年代机器学习方法的兴起,再到近年来深度学习和大型语言模型(LLM)的革命性突破。NLP的核心任务包括自然语言理解(NLU)和自然语言生成(NLG),其目标是通过计算机理解和生成人类语言。在材料科学领域,NLP技术的应用主要集中在自动提取材料成分、合成路径和性能数据等方面。早期的NLP工具如ChemDataExtractor和OSCAR4专注于化学文献的信息提取,而现代LLM(如GPT、BERT)则通过预训练和微调技术,实现了更高效、更灵活的材料数据挖掘。

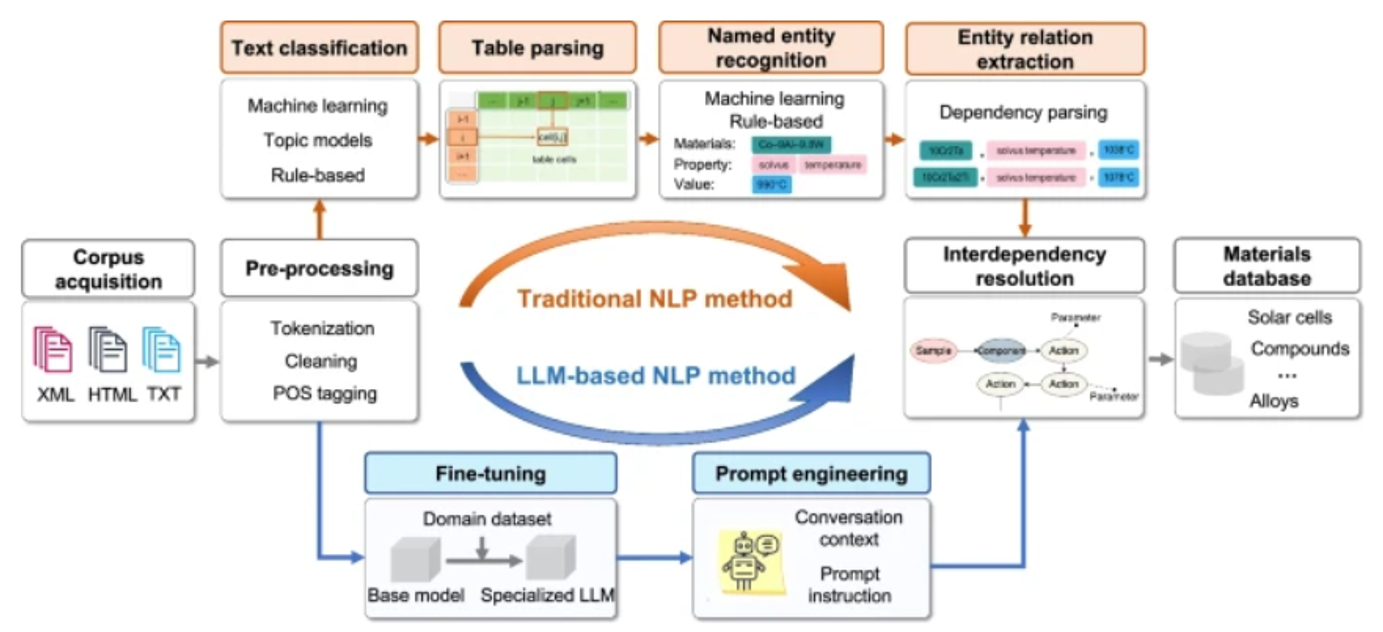

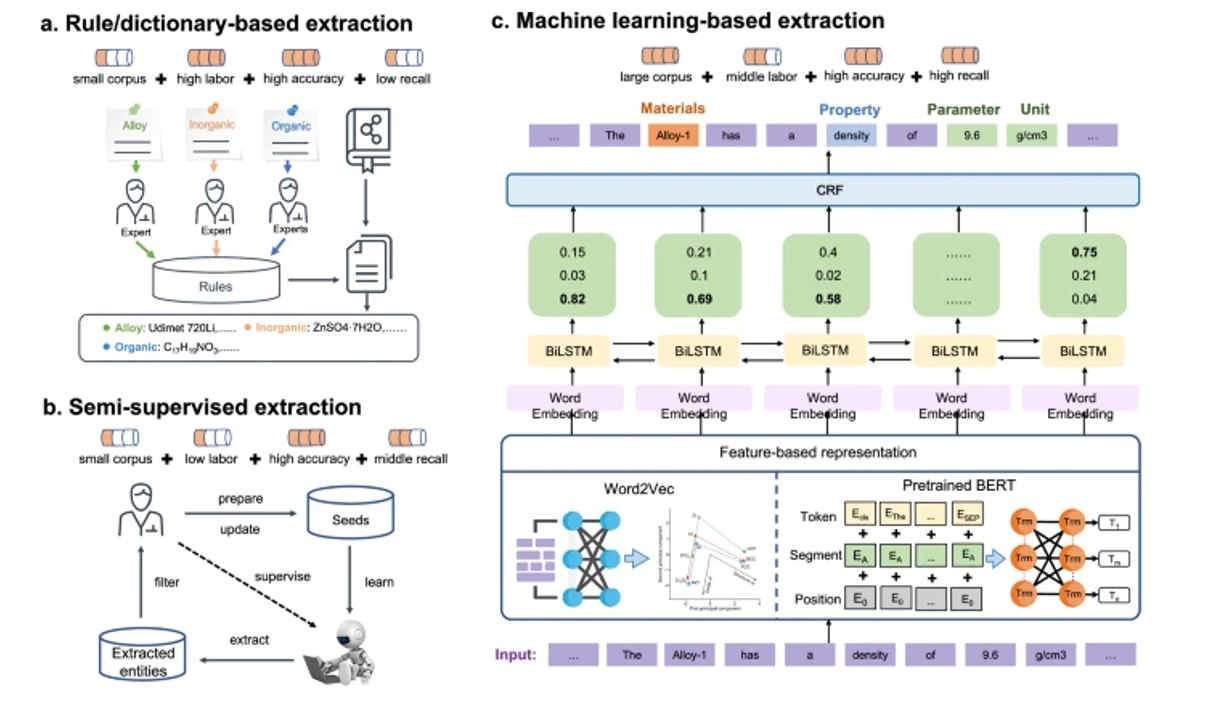

传统NLP方法依赖于标注数据和特定任务模型,例如使用双向长短时记忆网络(BiLSTM)结合条件随机场(CRF)进行命名实体识别(NER)和关系提取。虽然这些方法在特定任务中表现良好,但其灵活性和泛化能力有限。相比之下,LLM通过提示工程(Prompt Engineering)和微调(Fine-tuning)实现了更广泛的信息提取能力。例如,GPT模型能够通过精心设计的提示从文献中提取合成参数,而无需额外的训练数据。文章还指出,LLM的优势在于其能够处理复杂的语义关系和上下文信息,但其在材料科学领域的应用仍需解决领域适配和数值理解等问题。

词嵌入技术(如Word2Vec、GloVe)通过将词汇映射到低维向量空间,捕捉了材料科学术语之间的语义关系。例如,Tshitoyan等人利用Word2Vec模型分析了330万篇材料科学摘要,发现了一些潜在的热电材料,这些材料在文献中并未明确标注为热电材料。类似地,Pei等人通过词嵌入技术成功预测了高熵合金的组成,展示了其在材料设计中的潜力。然而,静态词嵌入(如Word2Vec)无法处理词汇的多义性,而动态词嵌入(如BERT)通过上下文感知的表示弥补了这一缺陷。

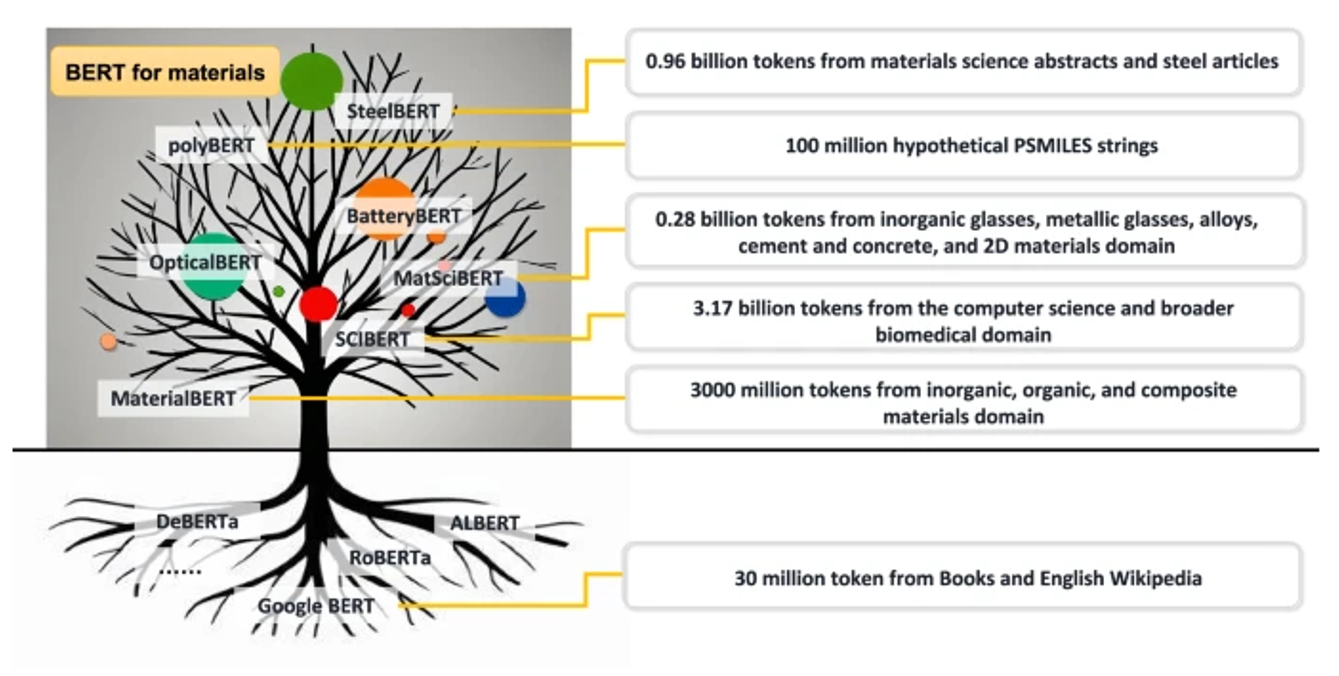

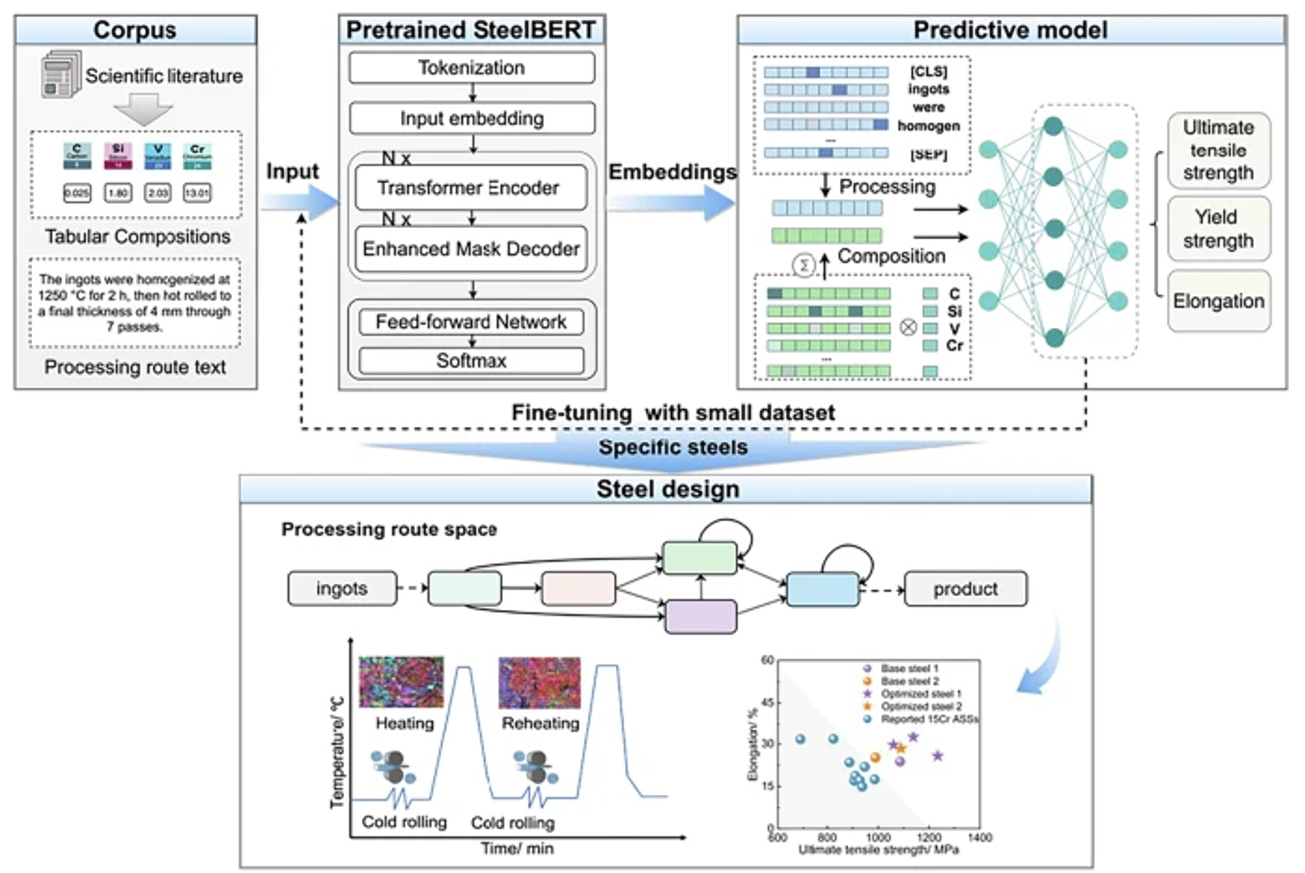

为了提升LLM在材料科学中的表现,研究人员开发了多种领域专用的BERT模型,如SciBERT、MatSciBERT和SteelBERT。这些模型通过在材料科学文献上进行预训练,显著提升了其在命名实体识别、关系分类和文档分类等任务中的性能。例如,SteelBERT专注于钢铁材料的研究,能够从文本中提取化学成分和加工路径,并预测力学性能。此外,Kuenneth等人开发的polyBERT通过聚合物化学指纹预测了多种聚合物性质,展示了语言模型在材料性能预测中的广泛应用前景。

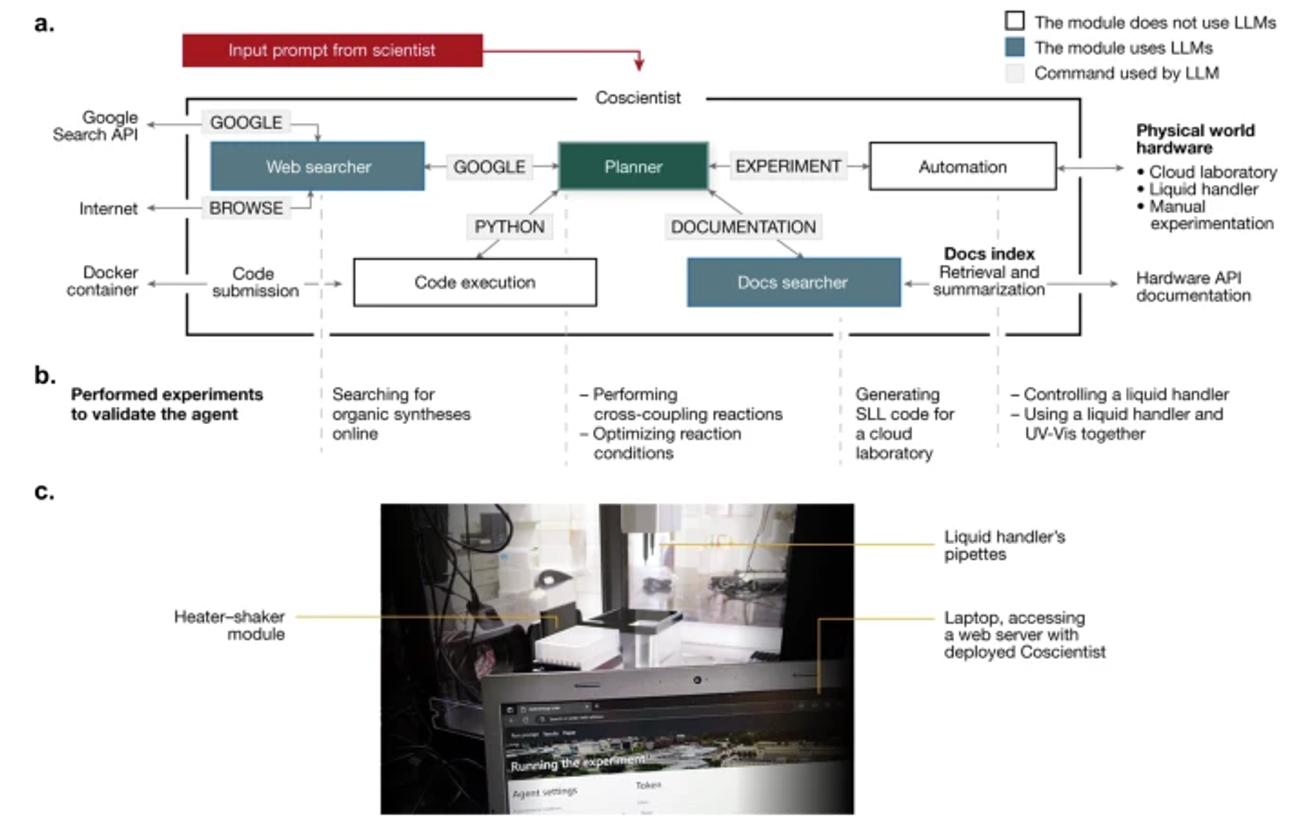

AI代理结合了LLM和外部工具(如实验平台、数据库),能够自主完成材料设计、实验规划和数据分析等任务。例如,Coscientist系统通过整合GPT-4和自动化实验设备,成功执行了复杂的化学合成实验。类似地,ChatMOF系统利用LLM实现了金属有机框架(MOF)的结构生成和性能预测,准确率超过95%。这些AI代理不仅提高了研究效率,还为材料科学的自动化探索开辟了新途径。

然而,尽管NLP和LLM在材料科学中取得了显著进展,但仍面临多项挑战:

1. LLM在处理数值数据和定量关系时表现不足,需开发更强大的数值编码和推理能力。

2. 材料科学的专业术语和复杂关系要求模型具备更深入的领域知识,可通过检索增强生成(RAG)等技术提升模型的可靠性。

3. 训练和部署大型模型需要高昂的计算成本,知识提取和模型压缩是潜在的解决方案。

4. 结合强化学习(RL)和多模态数据,提升模型在材料设计中的逻辑推理和创新能力。

未来,随着技术的进一步发展,LLM有望成为材料科学研究的核心工具,推动从数据挖掘到实验设计的全链条自动化,加速新材料的发现与应用。

图片概览

图1:NLP技术的发展与应用(转载于文献)

横轴代表 NLP 的不同发展阶段,从手工规则到大型语言模型,纵轴代表对应于信息提取、材料发现和自主设计的特定 NLP 任务。展示了NLP从规则方法到LLM的演进,以及其在材料信息提取、发现和自主设计中的应用。

图2:传统NLP与LLM的对比

展示了用于从科学文献中提取材料信息的 NLP 管道的示意图工作流程,其中包含传统的NPL和基于LLM的NLP方法,比较了两者在数据提取流程上的差异,突出了LLM通过提示工程和微调实现的高效性。

图3:NER与实体关系提取

介绍了基于规则、半监督和机器学习的命名实体识别方法,展示了BiLSTM-CRF模型的工作原理。

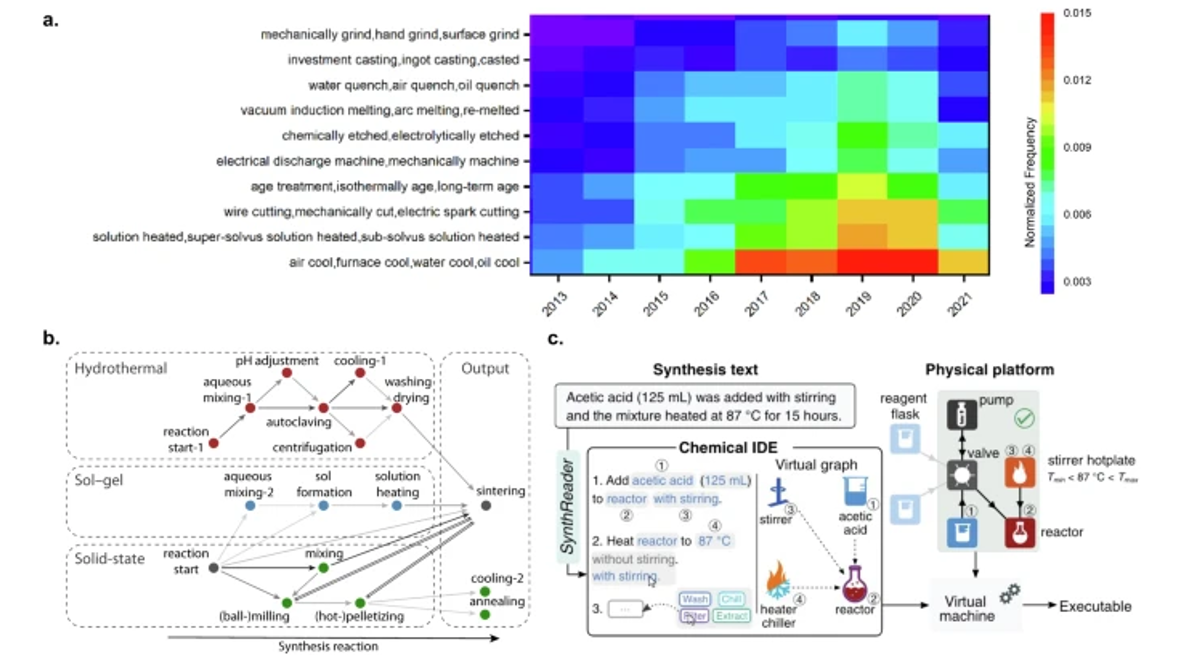

图4:材料合成路径提取案例(转载于文献)

a 2004 年至 2021 年报告的高温合金提取作用频率的热图(部分);b 不同类型合成的实验步骤之间过渡的机器学习流程图;c 将使用自然语言描述的合成程序转换为独立于硬件的化学代码的系统工作流程,该代码可以作为自然语言表示和可视化编辑,但内部存储为 XML;展示了从文献中提取合金合成路径的流程,包括热图分析和机器学习生成的流程图。

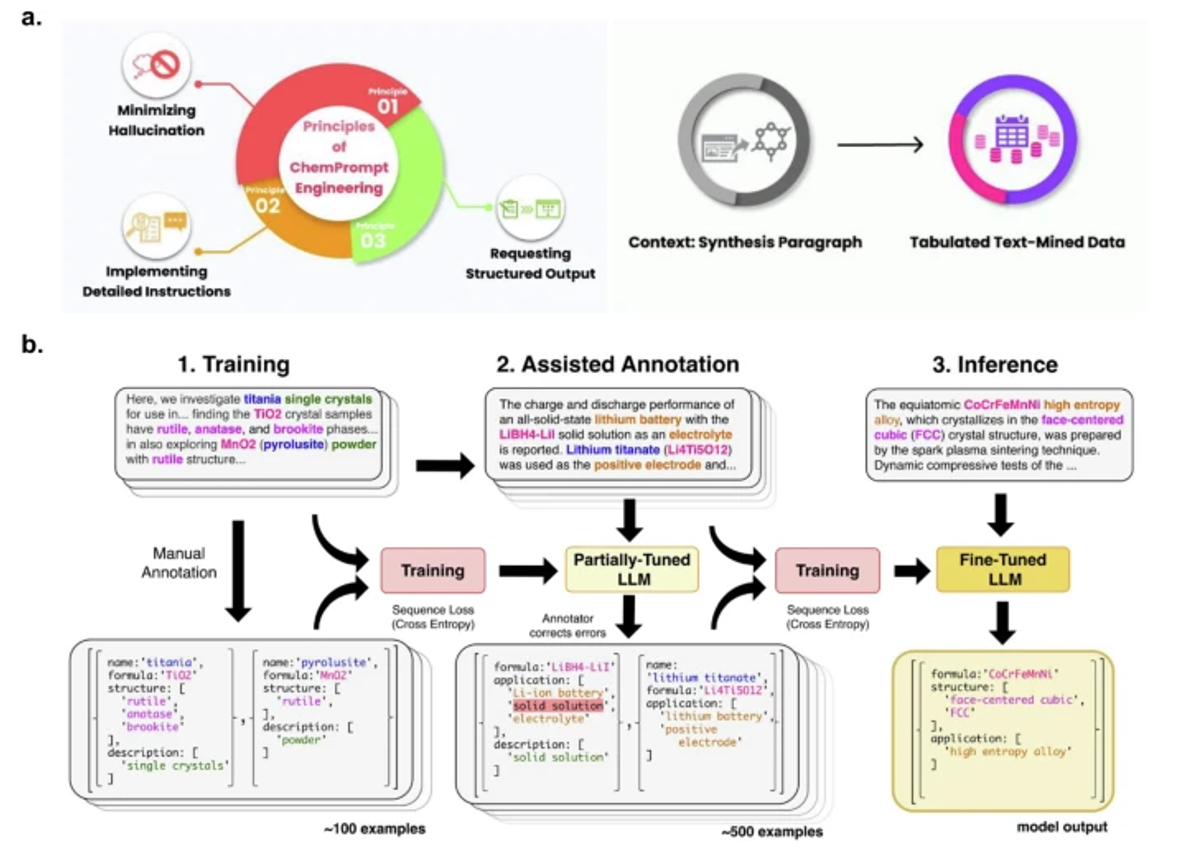

图5:LLM的信息提取能力(图片来源于文献)

a ChemPrompt 工程的三个核心原则,用于从研究文章的特定部分提取和总结合成条件,以将信息组织成结构良好的表格;b 通过在“人环系统”注释过程中对 LLM 进行部分训练,对材料进行文档级联合命名实体识别和关系提取。通过ChemPrompt Engineering和文档级实体识别,展示了LLM在材料数据提取中的高精度表现。

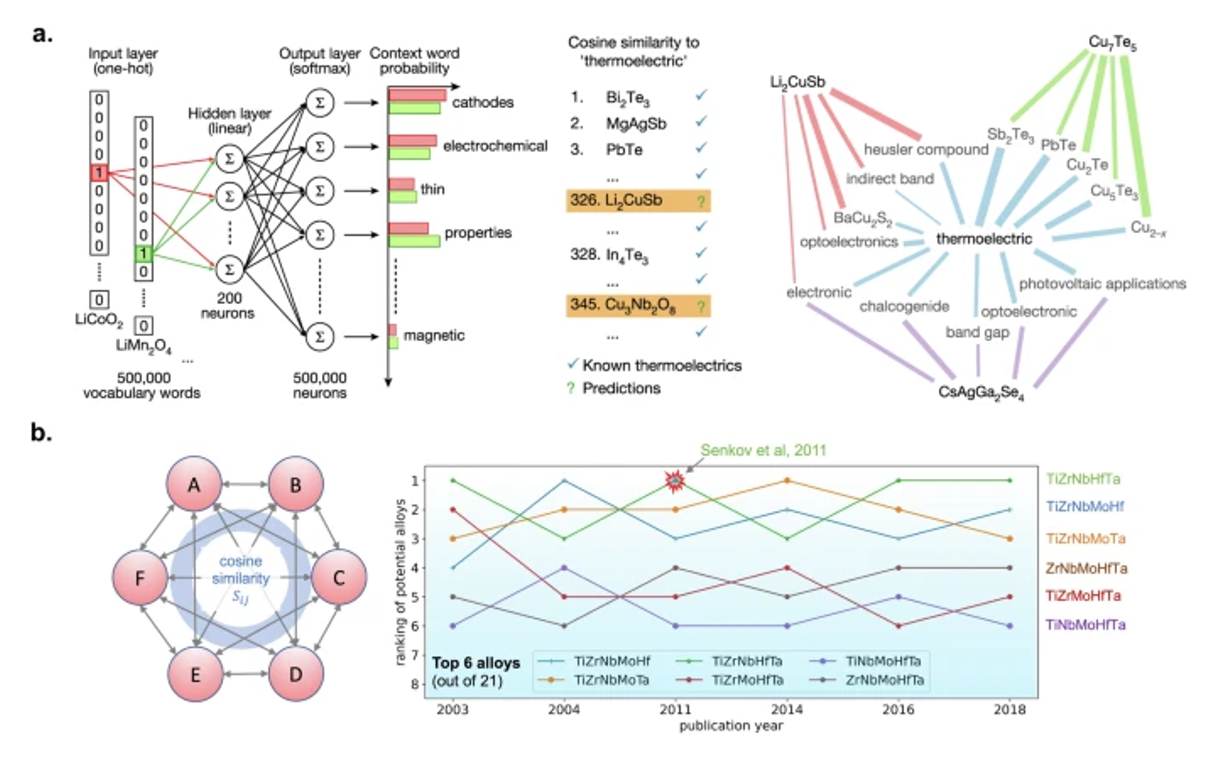

图6:词嵌入在材料发现中的应用(图片来源于文献)

a 独热编码向量用作具有单个线性隐藏层的神经网络的输入,该隐藏层经过训练以预测给定目标词的上下文词。使用材料嵌入的余弦相似性与单词“热电”嵌入产生的热电材料排名;b 要设计具有词嵌入的多组分高熵合金,一种方法从一个必须包含的元素开始,然后根据余弦相似性选择其四个最相似的元素。第二种方法平等地考虑所有参与元素与任意两个元素的余弦相似性,以平均来衡量其作为候选元素的效力。五组分合金根据其在不同出版年份的上下文相似性进行排序,包括 TiZrNbHfTa、TiZrNbMoHf 和 TiZrMoHfTa 的 Senkov 合金。说明了Word2Vec模型通过语义相似性识别潜在热电材料和高熵合金。

图7:材料专用BERT模型

介绍了基于BERT的领域适配模型(如MatSciBERT、BatteryBERT)及其在材料设计中的应用。

图8:SteelBERT的性能预测

使用 SteelBERT 进行定量力学性能预测,包括语料库收集、预训练、钢材信息的上下文感知表示、使用深度学习网络的预测模型以及奥氏体不锈钢设计的实验室数据集微调的几个步骤。展示了通过文本嵌入预测钢材力学性能的流程,以及实验室数据微调的效果。

图9:自主实验系统Coscientist(c图来源于文献)

a Coscientist 由多个交换消息的模块组成。蓝色背景的框代表 LLM 模块,Planner 模块显示为绿色,输入提示为红色。白色框代表不使用 LLM 的模块。b 使用单个模块或其组合进行的实验类型。c 带有液体处理器的实验装置的图像。描述了AI代理如何通过多模块协作完成化学实验的规划与执行。

研究价值

本文的研究价值在于系统性地展示了自然语言处理(NLP)和大型语言模型(LLM)如何革新材料科学研究范式。通过自动提取和分析海量文献数据,这些技术显著提升了新材料发现的效率,如GPT-4在合金设计中提出的方案经实验验证优于人类专家。研究构建了结构化知识库和动态知识图谱,推动材料研究从经验驱动转向数据驱动,同时通过ChatMOF等工具降低了科研门槛,促进学科交叉创新。更重要的是,该研究展示了"人机协作"的新科研模式,如AI系统Coscientist能独立完成跨学科实验,使单篇论文产出时间缩短40%。这些突破不仅在新能源、半导体等关键领域产生实质影响,更深远的意义在于重构了整个材料创新体系,为最终实现材料研究的"自动驾驶"模式奠定了基础。

小结

本文系统总结了NLP和LLM在材料科学中的前沿应用,展示了其在数据提取、材料发现和自主研究中的巨大潜力。尽管面临数值理解、领域适配和资源消耗等挑战,但通过模型优化和技术整合,LLM有望成为材料研究的核心工具,推动材料科学的快速创新。未来,结合多模态数据和强化学习,LLM将进一步实现从文献挖掘到实验设计的全链条自动化,为材料基因组工程提供强大支持。